Let us explain why technology is a more powerful social force than the aspiration for freedom.

(Theodore Kaczynski, Industrial Society and Its Future, § 126)

Uno de los temas que, desde la primavera pasada, está gozando de una atención mediática cada vez mayor ha sido sin duda el de la inteligencia artificial. Su proliferación cabe atribuirla en buena medida a la popularidad que han alcanzado algunas de sus aplicaciones, como el prototipo de chatbot de inteligencia artificial ChatGPT, desarrollado en 2022 por OpenAI y puesto a disposición de los usuarios online en fecha reciente; aunque debería destacarse también, en este sentido, la aparición de una serie de voces críticas, desde sectores altamente competentes en el tema, que han comenzado a poner sobre la mesa los graves peligros que podría acarrear, «para la humanidad», una entrega a la inteligencia artificial sin los necesarios controles. Podría hacerse el relato de la aparición reciente de este frente polémico tomando convencionalmente como punto de partida el artículo que publica Noam Chomsky en The New York Times, el 11 de marzo de este año, con el título de «The False Promise of ChatGPT».

Se trata de un texto relativamente breve (no llega a las dos mil palabras) en el que impugna de raíz cualquier extrapolación utópica de la IA, subrayando qué es lo que en esta cuestión no debe perderse de vista. Dice allí: «A diferencia de ChatGPT y sus similares, la mente humana no es una pesada máquina estadística de comparación de patrones, que se atiborra de cientos de terabytes de datos y extrapola la contestación más probable en una conversación o la respuesta más probable a una pregunta científica. Por el contrario, la mente humana es un sistema sorprendentemente eficiente e incluso elegante que funciona con pequeñas cantidades de información; no busca inferir correlaciones brutas entre puntos de datos, sino crear explicaciones». Y es que, viene a decir, las explicaciones pertenecen al campo del sistema neuronal de los humanos, y en ello consiste la marca que nos diferencia de las máquinas llamadas inteligentes, cuyo «defecto más profundo es la ausencia de la capacidad crítica que tiene cualquier inteligencia: decir no solo lo que es el caso, lo que fue el caso y lo que será el caso —eso es descripción y predicción—, sino además lo que no es el caso y lo que podría y no podría ser el caso. Esos son los ingredientes de la explicación, la marca de la verdadera inteligencia».

Y, a continuación, pone como ejemplo una conversación mantenida por su colaborador Jeffrey Watumull en ChatGPT, a propósito de si sería ético transformar Marte para que pudiera albergar vida humana. Vistos los resultados («ChatGPT exhibe algo parecido a la banalidad del mal: plagio, apatía y obviedad. Resume los argumentos estándar de la literatura mediante una especie de superautocompletado [a kind of super-autocomplete], se niega a adoptar una postura sobre lo que sea, alega no solo ignorancia sino falta de inteligencia y, en última instancia, se defiende con un “solo cumplía órdenes”, trasladando la responsabilidad a sus creadores»), el dictamen de Chomsky es demoledor: «Dada la amoralidad, pseudociencia e incompetencia lingüística de estos sistemas, no nos queda sino reír o llorar ante su popularidad».

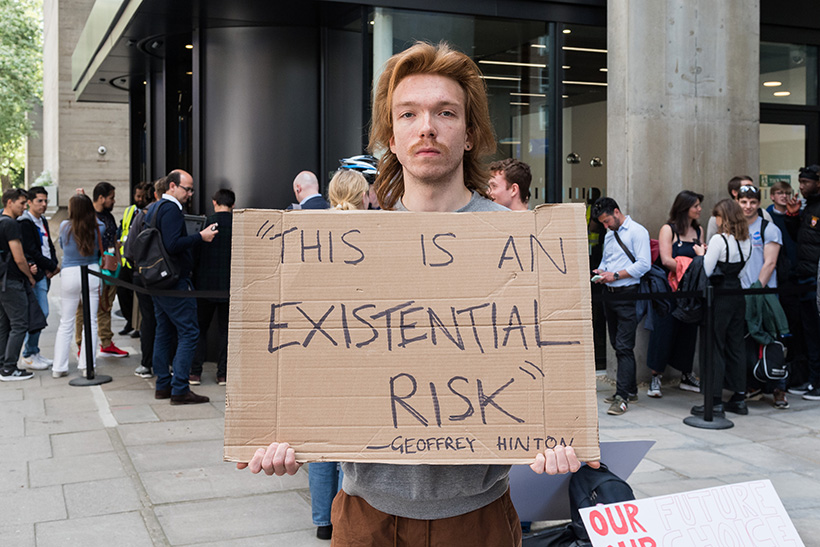

Dicho esto, unos pocos días después, el tema volverá a los titulares de los medios con una noticia de impacto: «Geoffrey Hinton, el “padrino de la IA”, renuncia a Google y alerta de los peligros de la IA». Y sin apenas tiempo para reponerse del sobresalto, ahora será todo un colectivo de empresarios, directores técnicos e investigadores los que deciden mostrar su discrepancia; y en consecuencia firman (la BBC hablaba el 29 de marzo de «más de mil personas») una declaración en la que piden que «se detenga de inmediato, durante al menos seis meses, el entrenamiento de los sistemas de inteligencia artificial más potentes que GPT-4»; y solemnemente declaran que «mitigar el riesgo de extinción [acarreado por] la IA debería ser una prioridad mundial, junto con otros riesgos a escala social como las pandemias y la guerra nuclear». Luego, como una cadena de acontecimientos que explosionan por simpatía, llega la información de que Suecia ha decidido erradicar los teléfonos móviles y las pantallas de las escuelas, aduciendo que son adictivos y perjudiciales para el desarrollo de la atención y la comprensión lectora. Y a partir de ahí, se multiplicarán en los medios las informaciones sobre la política de los diferentes países al respecto, con toda suerte de detalles y resonancias. Este podría ser el relato apresurado de cómo, en unos pocos días, la IA pasó de ser un tema de actualidad para convertirse en un gravísimo problema, un riesgo de extinción para la humanidad comparable al de las pandemias o la guerra nuclear…

En el fondo, lo que da que pensar es que las alarmas hayan saltado precisamente ahora, como si llegar a un punto crítico fuera algo inminente. Porque, en cierto modo, todo esto ya se sabía y desde hace bastante tiempo; hace ya años que Google patentó la idea de crear un botón rojo que destruiría una inteligencia artificial si esta tuviera un comportamiento aberrante, y tampoco faltaron las investigaciones que analizaron al detalle el porvenir de las máquinas inteligentes. Como ejemplo eminente podría reseñarse la publicación, en 1999, del libro de Ray Kurzweil, The Age of Spiritual Machines: When Computers Exceed Human Intelligence. Y conviene recordar al respecto que el autor es uno de los creadores del mundo digital tal como hoy lo conocemos: inventor de procedimientos pioneros como el reconocimiento óptico de caracteres (OCR), la síntesis de texto a voz, la tecnología de reconocimiento de voz o los instrumentos de teclado electrónico.

Pues bien, en la tercera parte de su libro («To Face the Future»), después de haber conjeturado los progresos que el mundo digital alcanzaría en los primeros decenios del siglo XXI, interrumpe su relato y da un salto decididamente utópico, pasando a presentarle al lector el paisaje del año 2999 como una suerte de consumación simbólica del mundo digital (de cuya implantación se cumpliría un siglo) y como realización acabada de todas sus posibilidades también. Su descripción comienza diciendo: «Existe una fuerte tendencia hacia la fusión del pensamiento humano con el mundo de la inteligencia de las máquinas que la especie humana creó inicialmente. Ya no existe una distinción clara entre humanos y ordenadores». Y las razones que da para esta indistinción serán, de un lado, que los humanos («las entidades conscientes») no siempre están físicamente presentes en sus interrelaciones, y del otro, que las máquinas, cuya inteligencia está basada en «modelos ampliados de la inteligencia humana», pretenden ser humanas.

A partir de ahí, la indistinción está servida. «El número de seres humanos basados en software supera con creces a los que aún utilizan la computación nativa basada en células neuronales. Incluso entre las inteligencias humanas que todavía utilizan neuronas basadas en el carbono, hay un uso omnipresente de la tecnología de implantes neuronales que proporciona un enorme aumento de las capacidades perceptivas y cognitivas humanas. Los humanos que no utilizan estos implantes son incapaces de participar de forma significativa en diálogos con los que sí los utilizan». Y concluye esta suerte de profecía con la buena nueva de una inmortalidad tecnológica: «La esperanza de vida ya no es un término viable en relación con los seres inteligentes».

Kurzweil es un distinguido tecnófilo; es alguien que está convencido de que el rasgo característico más eminente del Homo sapiens es la invención de la tecnología; y que la tecnología ha sido una herramienta privilegiada de la evolución, y seguirá siéndolo de un modo cada vez más terminante. Desde este punto de vista se entiende que no considere el paisaje descrito para 2999 como una distopía, antes al contrario. Y, sin embargo, el libro de Kurzweil comparte tanto la panorámica general como buena parte de sus análisis y predicciones con un escrito de infausta memoria para los estadounidenses, Industrial Society and Its Future, de Theodore Kaczynski, alias Unabomber, en el que este desarrollaba una visión apocalíptica de las tecnologías y defendía la necesidad de un retorno a la naturaleza. De hecho, Kurzweil cita a Kaczynski en su libro, y maneja descripciones y predicciones que son del todo compatibles con las enunciadas por este autor cuatro años antes. Y la única reprobación que Kurzweil le hace no es teórica, sino política: «Aunque expone argumentos convincentes sobre los peligros y daños que han acompañado a la industrialización, la visión que propone no es ni convincente ni factible. Al fin y al cabo, queda muy poca naturaleza a la que volver y hay demasiados seres humanos. Para bien o para mal, estamos atrapados en la tecnología». A los efectos de la argumentación, podría decirse que la pregunta que trata de contestar Kaczynski en su Manifiesto es precisamente esta: ¿Qué significa exactamente «estar atrapados en la tecnología»?

En un capítulo de su texto, homólogo al de Kurzweil («The Future»), Kaczynski comienza situándonos cara a cara con la IA: «En primer lugar, supongamos que los informáticos consiguen desarrollar máquinas inteligentes capaces de hacer todas las cosas mejor que los seres humanos. En ese caso, presumiblemente todo el trabajo será realizado por vastos sistemas de máquinas altamente organizados y no será necesario el esfuerzo humano. Podrían darse dos casos. Las máquinas podrían tomar sus propias decisiones sin supervisión humana, o bien podría mantenerse el control humano sobre las máquinas» (§ 172). En el primer caso, si se decidiera dejar que el destino de la raza humana quedara a merced de las máquinas, nada puede conjeturarse sobre cuál sería su comportamiento; aunque Kaczynski subraya que tal decisión no dependería de ninguna suerte de servidumbre voluntaria, porque «la raza humana podría fácilmente dejarse llevar a una posición tal de dependencia de las máquinas que no tendría otra opción práctica que aceptar todas las decisiones de las máquinas».

El modo en que Kaczynski piensa el proceso es en los términos de la conocida parábola de las ranas y el agua hirviendo. «Con el tiempo se llegará a un punto en el que las decisiones necesarias para mantener el sistema en funcionamiento serán tan complejas que los seres humanos serán incapaces de tomarlas de forma inteligente. En ese momento, las máquinas tendrán el control efectivo. La gente no podrá simplemente apagar las máquinas, porque dependerá tanto de ellas que apagarlas equivaldría a un suicidio» (§ 173). En el segundo caso, si se mantuviera el control humano sobre las máquinas, la gente tendría el control sobre sus máquinas privadas, «pero el control sobre grandes sistemas de máquinas estará en manos de una pequeña élite, igual que hoy, pero con dos diferencias. Debido a la mejora de las técnicas, la élite tendrá un mayor control sobre las masas; y como el trabajo humano ya no será necesario, las masas serán superfluas, una carga inútil para el sistema». Kaczynski contempla al respecto tres opciones: (1) que la élite sea despiadada; podría decidir entonces exterminar en masa a la humanidad; (2) que la élite sea humana; podría servirse de «la propaganda u otra técnica psicológica o biológica para reducir la tasa de natalidad hasta que la masa de la humanidad se extinga, dejando el mundo a la élite», y, finalmente, (3) si la élite estuviera «formada por liberales de corazón tierno, podrían decidir desempeñar el papel de buenos pastores para el resto de la raza humana». Sin embargo, incluso en este caso, «la vida será tan inútil que la gente tendrá que ser biológica o psicológicamente manipulada [engineered] para eliminar su necesidad del proceso de poder o para hacerles “sublimar” su impulso de poder en algún pasatiempo inofensivo. Estos seres humanos manipulados pueden ser felices en una sociedad así, pero sin duda no serán libres. Habrán sido reducidos a la condición de animales domésticos» (§ 174). Es decir, en los tres casos nos encontraríamos ante el riesgo de extinción de la humanidad que tan recientemente ha cobrado actualidad.

El Manifiesto de Theodore Kaczynski se publicó originalmente en The Washington Post, en colaboración con The New York Times, el 19 de septiembre de 1995, es decir, hace casi treinta años. Si desde entonces es público y sabido el grave riesgo implicado en una expansión tecnológica guiada únicamente por sus propias posibilidades de desarrollo y el afán de lucro de sus desarrolladores, ¿qué extraña fascinación ha cegado y enmudecido a todos los agentes implicados en el proceso durante todo este tiempo? ¿Y por qué hablan precisamente ahora? ¿Acaso hemos llegado a ese umbral catastrófico que se presentía desde que se puso en marcha el proceso de digitalización forzosa de la humanidad?

Solo quería deciros que sois unos máquinas Gracias por subir noticias aquí tenéis un nuevo seguidor

Siempre me sorprendéis.

Y para bien.

Bravo.

Hoy me he enterado -no soy muy despierto- que Iain M. Banks murió hace diez años.

Creo que leer su serie de la Cultura es interesante para cualquiera interesado en estos temas. La ciencia ficción suele tener un gran poder predictivo y su lenguaje está al alcance de tochos como yo.

Saludos.

Pingback: 'Mazinger Z': ¡Planeadoooooor abajo! - Jot Down Cultural Magazine